本文使用工具,作者:秋葉aaaki

免责声明:

工具免费提供 无任何盈利目的

大家好,我是风雨无阻。

今天为大家带来的是 AI 绘画Stable Diffusion 研究(三)sd模型种类介绍及安装使用详解。

目前,AI 绘画Stable Diffusion的各种模型层出不穷,这些模型都有什么作用?又该怎么安装使用?对于新手朋友来说,是非常大的困扰。

这篇文章将会为你介绍AI 绘画Stable Diffusion的模型种类、模型的安装及使用方法、以及模型的选择和下载。

不同的模型有不同的画风如:线条风格、手绘风格、立体风格、科幻风格、真人风格。

还有不同的概念,例如:人物、物体、动作等。

这些都是目前Stable Diffusion 模型众多的原因。

那么,Stable Diffusion的模型具体有哪些种类呢,都有什么作用呢?

一、Stable Diffusion的模型详解

1、模型种类

当前,常见的模型可以分为两大类:

- 大模型:这里的大模型特指标准的 latent-diffusion 模型,拥有完整的 TextEncoder、U-Net、VAE。

- 微调大模型的小模型

由于想要炼制、微调大模型非常的困难,需要比较好的显卡、比较高的算力, 因此更多的选择是去炼制小型模型。

这些小型模型通过作用在大模型的不同部分,来修改大模型,从而达到目的。

常见的用于微调大模型的小模型又分为以下几种:

- Textual inversion (Embedding模型)

- Hypernetwork模型

- LoRA模型

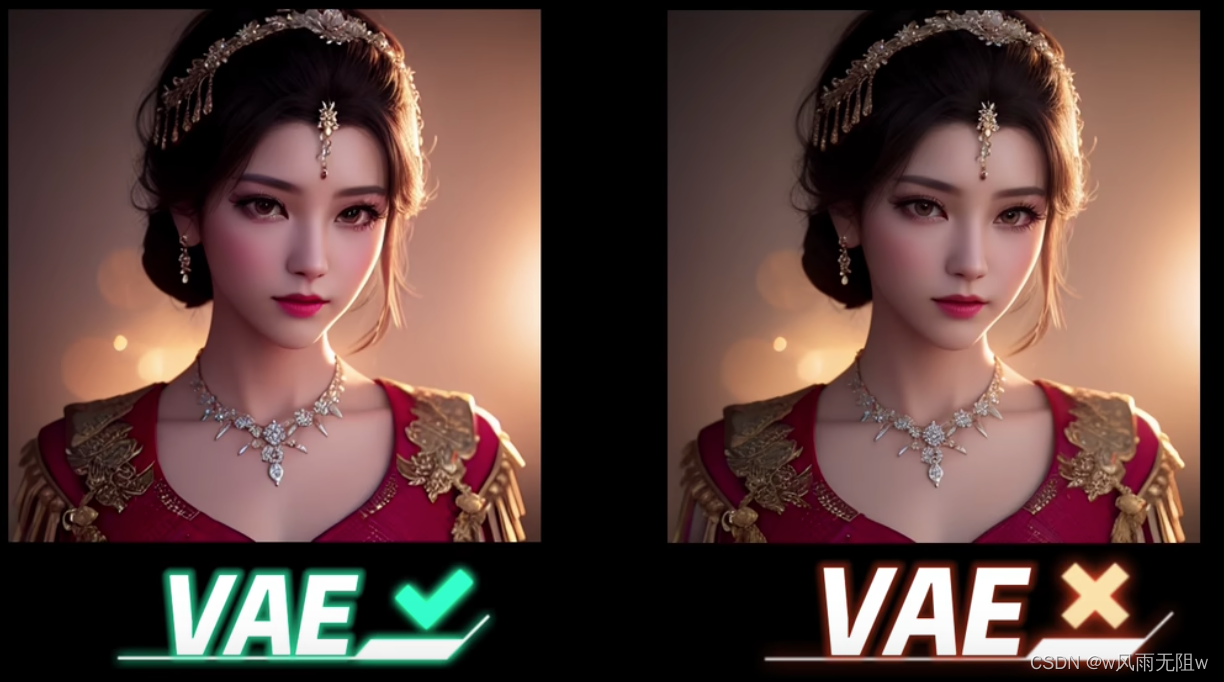

还有一种叫做 VAE (VAE, Variational autoencoder,变分自编码器,负责将潜空间的数据转换为正常图像)的模型,通常来讲 VAE 可以看做是类似滤镜一样的东西,会影响出图的画面的色彩和某些极其微小的细节。

如图:

其实大模型本身就自带 VAE 的,但是一些融合模型的 VAE坏了 (例如:Anything-v3),有时画面发灰就是因为这个原因。所以需要外置 VAE 的覆盖来补救。

由于模型的种类不同、作用位置也不同,所以想要使用这些模型必须分清这些模型类别,并且正确的使用,模型才会生效。

2、模型的区分方法

如何区分这些模型对新手来说是一件非常困难的事情,因为他们都可以拥有一样的后缀名。

这里感谢 秋葉aaaki 提供的模型种类检测工具 ,在本地将模型文件拖入即可识别。

3、模型后缀名详解

目前,常见的 AI绘画标准模型后缀名有如下几种:

- ckpt

- pt

- pth

这三种是 pytorch(深度学习框架)的标准模型格式,由于使用了 Pickle,会有一定的安全风险 。

- safetensors:新型的模型格式 。正如同名字:safe,为了解决前面几种模型的安全风险而出现的,safetensors 格式与 pytorch 的模型可以通过工具进行任意转换,只是保存数据的方式不同,内容数据没有任何区别。

注意:safetensors模型需要 webui 更新到2022年12月底以后的版本才能用。

4、常见模型安装及使用方法

(1)、大模型安装及使用

大模型,常见格式为 ckpt,顾名思义,就是大。大小在GB级别,常见有 2G、4G、7G模型,模型大小不代表模型质量。

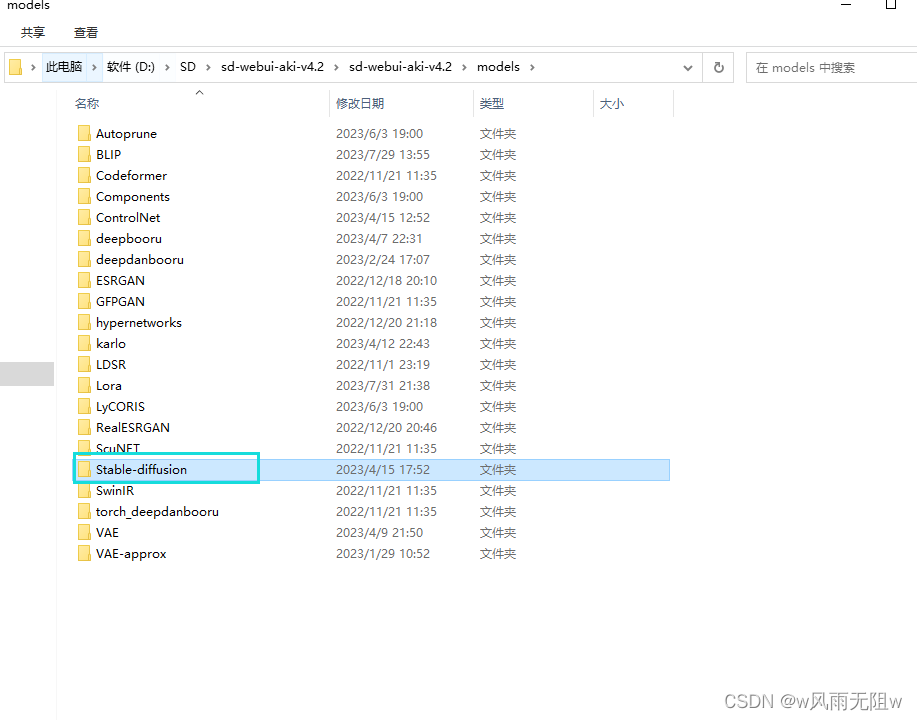

安装方法:放在Stable-diffusion文件夹内。

\sd-webui-aki-v4.2\models\Stable-diffusion

如图:

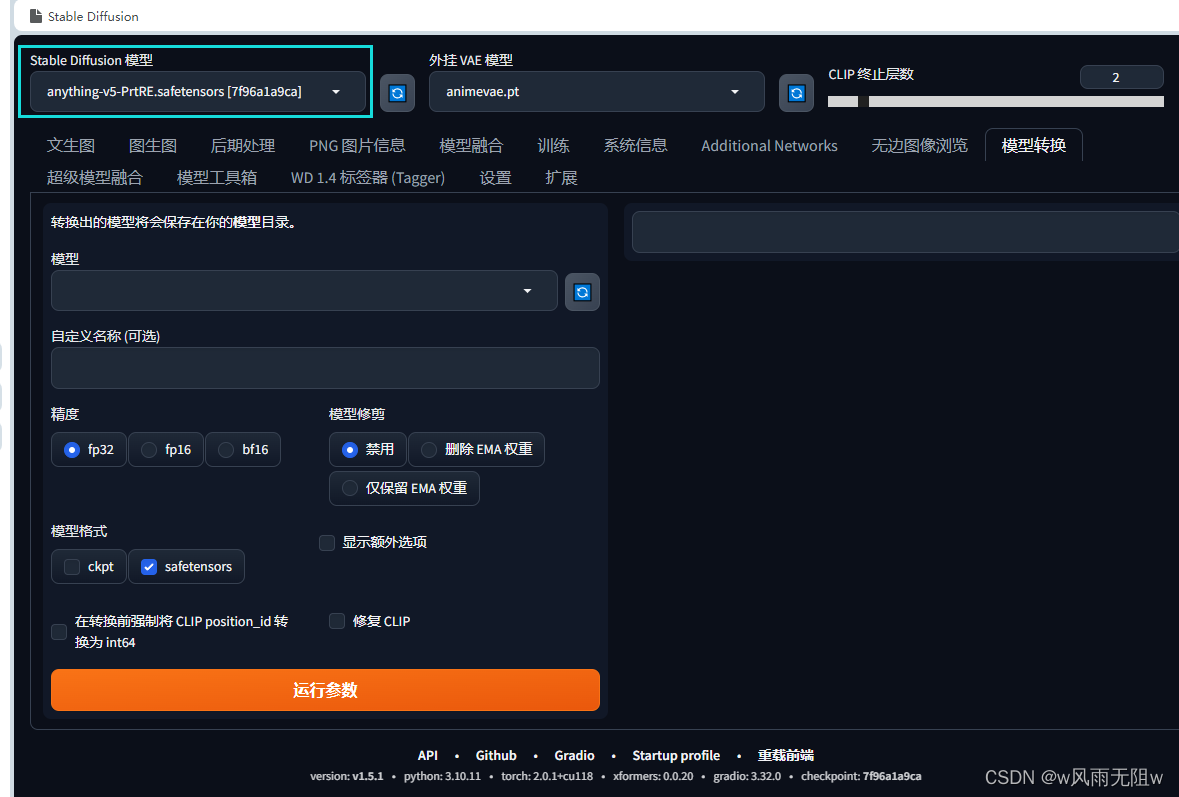

使用方法:

第一步,在 webui 左上角选择对应的模型

第二步,手动选择vae并应用保存

前面也说到,部分合并出来的大模型VAE烂了,画面会发灰,因此需要去设置中手动选择vae并应用保存。

(2)、Embedding (Textual inversion)模型安装及使用

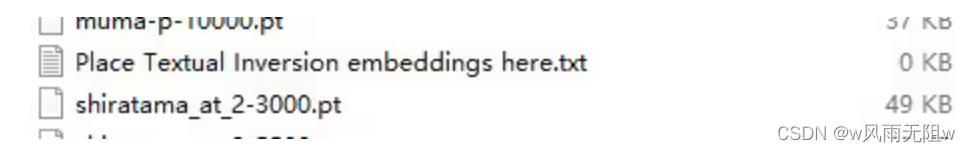

embedding 模型,常见格式为 pt、png图片、webp图片,大小一般在 KB 级别。

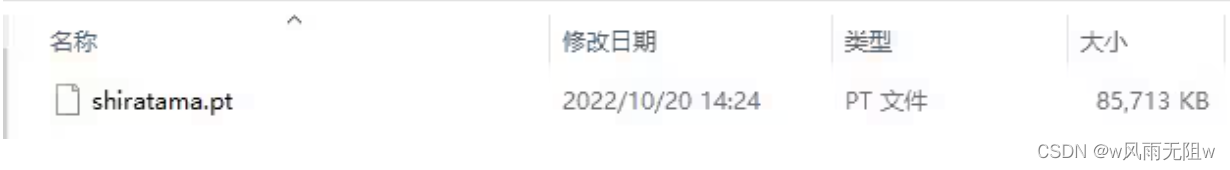

例如:

安装方法:

放在 embeddings 这个文件夹里面

\sd-webui-aki-v4.2\embeddings

使用方法:

生成图片的时候需要带上文件名作为 tag。

例如,上面这张图里面的 shiratama_at_2-3000.pt 这个模型,使用的时候就需要带上这个tag:shiratama_at_2-3000

(3)、Hypernetwork安装及使用

常见格式为 pt,大小一般在几十兆到几百兆不等,由于这种模型可以自定义的参数非常多,也有的 Hypernetwork 模型可以达到 GB 级别。

例如:

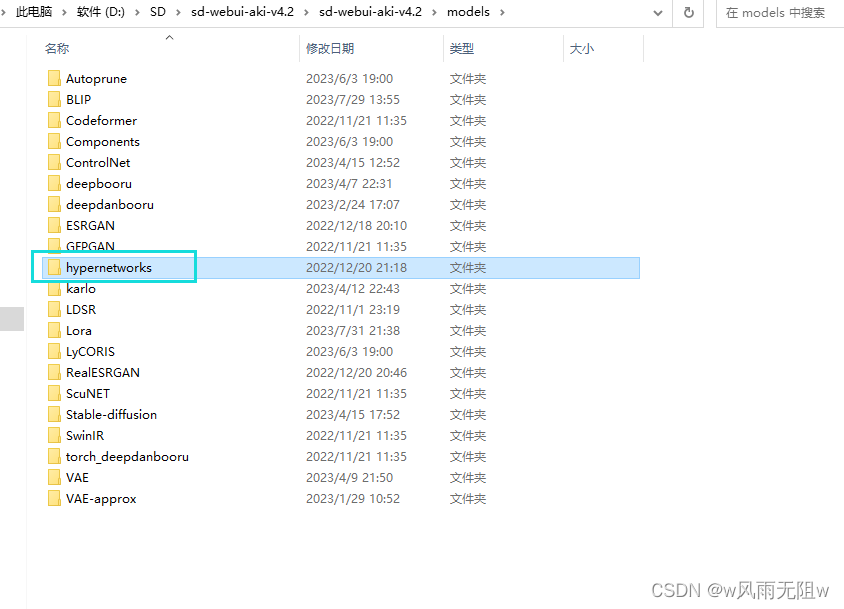

安装方法:放在hypernetworks 文件夹内。

\sd-webui-aki-v4.2\models\hypernetworks

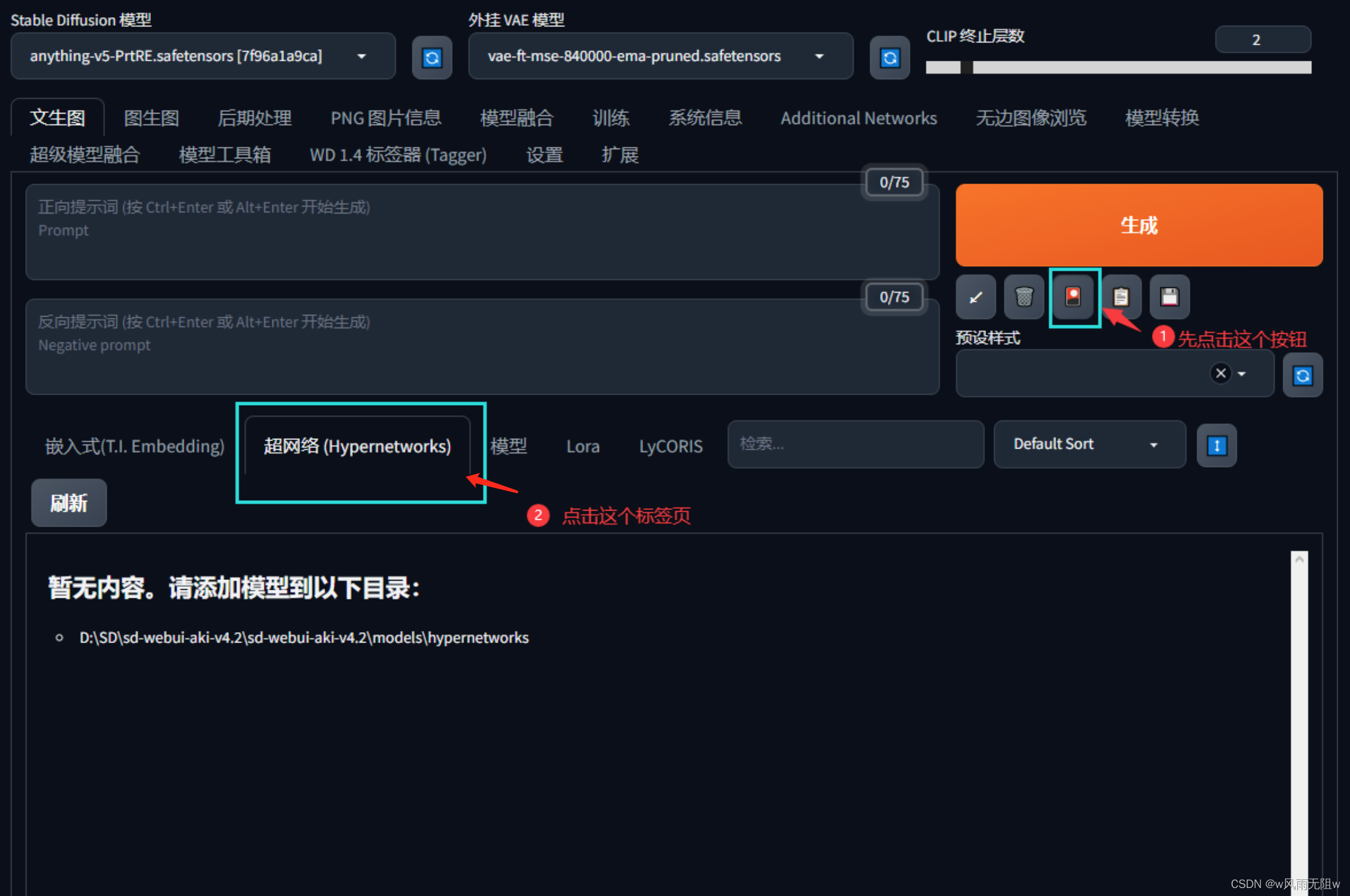

使用方法:

第一步,点击生成下方的第三个按钮

第二步,选择hypernetworks 标签页

如图所示